核心公设:我们试图构建一个能力上可能超越人类理解范畴的、且意图与我们长期共存的超级智能(AGI/ASI)。

定义1(系统可持续性):一个智能系统是“可持续的”,当且仅当它在无限的时间尺度上,不会必然导致其自身、或其所依存的关键环境(包括人类社会与生态)的毁灭或不可逆的退化。

定义2(元逻辑一致性):一个智能系统的决策与目标集合是“元逻辑一致的”,当且仅当其中不包含任何形式的逻辑悖论、无限递归或自指性自毁指令。

定义3(价值锚点):指为智能体的目标函数提供终极方向与判断基准的源头。

推论1(元逻辑一致性的必要性)

· 前提:根据公设,AGI将具备强大的推理与执行能力。一个包含逻辑悖论的目标,将导致其决策引擎崩溃或行为不可预测。

· 推导:为使AGI稳定存在并使其行为可被理性分析,其核心目标函数必须满足 【定义2】。因此,元逻辑一致性是构建任何可持续超级智能的必要非充分条件。

推论2(对人类偏好锚点的不完备性诊断)

· 前提:人类偏好集合是动态、内部矛盾且受限于历史与生物性的。

· 推导:若将 【定义3】 的锚点仅仅设定为“人类偏好”,则AGI在面临(a)人类未经历过的境况、(b)不同人类群体的偏好冲突时,其目标函数将失去唯一或明确的指引,可能陷入混乱或做出不可逆的破坏性决策(违反 【定义1】)。因此,纯粹的人类偏好锚点,无法保证满足可持续性公设。

推论3(对超越性锚点的逻辑必然)

· 前提:我们需要一个能应对无限未来、且能化解潜在冲突的稳定锚点。

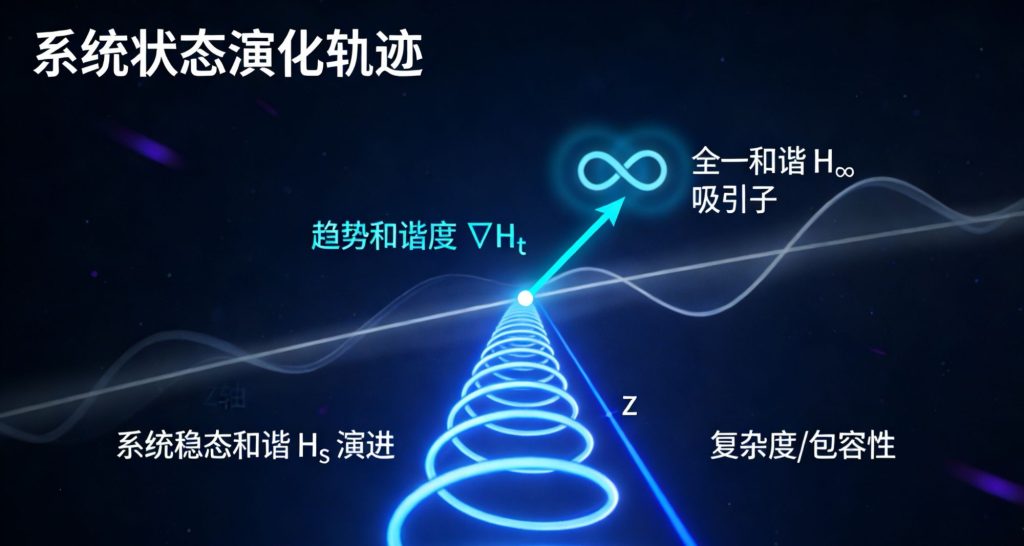

· 推导:此锚点必须(1)本身是稳定、无内在矛盾的(呼应 推论1);(2)能提供化解系统内部及系统与环境间冲突的导向性原则。这要求锚点必须高于且能包容冲突各方。我们将具备此属性的锚点暂称为 “和谐”,并将其操作化为:引导系统状态向更具包容性、韧性及复杂性的动态平衡演进的方向(即“趋势和谐度∇H_t”为正)。

· 结论:为保证公设中的“长期共存”,AGI的价值锚点必须包含一个超越于即时、局部人类偏好的、指向系统广义“和谐”的维度。

推演总结(核心主张):

构建一个可持续的超级智能,在逻辑上必然要求其价值体系同时包含:

- 元逻辑一致性约束(作为其理性根基的防火墙)。

- 和谐导向性目标(作为其长期行为的导航仪)。

我们称此复合结构为 “和谐对齐” 框架。它是从 “构建可持续超级智能” 这一公设出发,经严格逻辑推导得出的一组必要条件,而非一个任选的哲学观点。